Jeux olympiques de Paris 2024 : le projet français de surveillance par l’IA suscite des inquiétudes

Publié par BBC.com le 19 juillet 2023

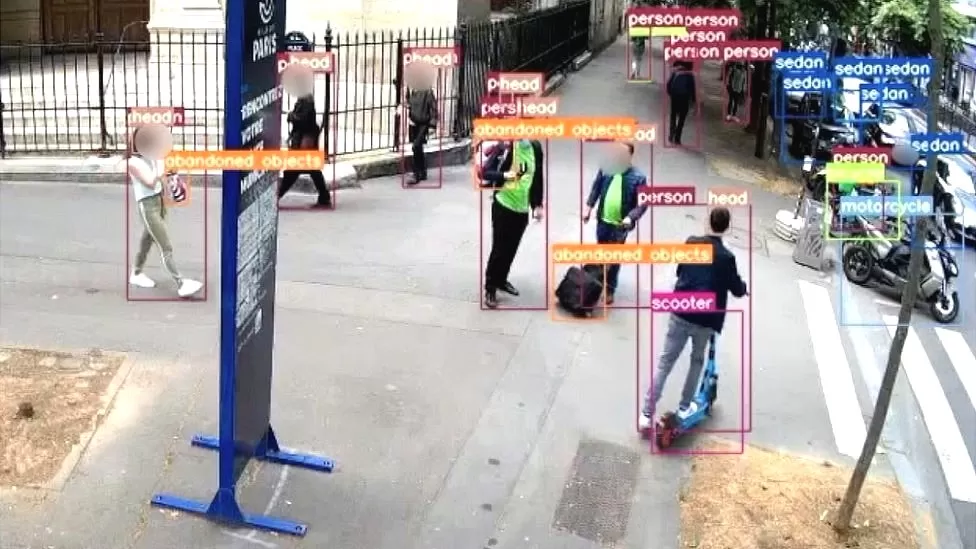

Bagages abandonnés et foules inattendues : des caméras en temps réel utiliseront l’intelligence artificielle (IA) pour détecter les activités suspectes dans les rues de Paris pendant les Jeux olympiques de l’été prochain. Mais les groupes de défense des droits civiques estiment que cette technologie constitue une menace pour les libertés civiles, comme le rapporte Hugh Schofield de la BBC.

« Nous ne sommes pas la Chine ; nous ne voulons pas être Big Brother », déclare François Mattens, dont la société d’intelligence artificielle basée à Paris est candidate à une partie du contrat de vidéosurveillance des Jeux olympiques.

En vertu d’une loi récente, la police pourra utiliser les algorithmes de vidéosurveillance pour repérer des anomalies telles que des mouvements de foule, des bagarres ou des sacs laissés sans surveillance.

La loi exclut explicitement l’utilisation de la technologie de reconnaissance faciale, telle qu’adoptée par la Chine, par exemple, afin de repérer les personnes « suspectes ».

Mais les opposants estiment qu’il s’agit là d’une solution de facilité. Même si la période expérimentale autorisée par la loi prend fin en mars 2025, ils craignent que le véritable objectif du gouvernement français ne soit de rendre permanentes les nouvelles dispositions en matière de sécurité.

« Nous avons déjà vu cela lors de Jeux olympiques précédents, comme au Japon, au Brésil et en Grèce. Ce qui était censé être un dispositif de sécurité spécial pour les circonstances particulières des Jeux a fini par être normalisé« , explique Noémie Levain, de l’association de défense des droits numériques La Quadrature du Net (Squaring the Web).

Une version du nouveau système de sécurité IA est déjà en place dans certains commissariats de police en France. L’un des pionniers est le commissariat de Massy, dans la banlieue sud de Paris.

« La ville compte 250 caméras de sécurité, ce qui est beaucoup trop pour notre équipe de quatre personnes », explique Nicolas Samsoen, maire de Massy.

« Le dispositif d’IA surveille donc toutes les caméras. Lorsqu’il voit quelque chose qu’on lui a demandé de surveiller, comme un regroupement soudain de personnes, il lance une alerte.

« C’est alors aux humains – les officiers de police – d’examiner la situation et de déterminer les mesures à prendre. Il peut s’agir de quelque chose de grave ou non.

« L’important est que ce soit l’homme qui prenne la décision finale sur la manière de réagir, et non l’ordinateur. L’algorithme donne du pouvoir à l’homme.

À titre de test, nous avons abandonné un bagage dans la rue, non loin du poste de police. Trente secondes plus tard, l’alarme a été déclenchée et des images de vidéosurveillance de la valise sont apparues sur l’écran de la salle de contrôle.

Auparavant, il fallait bien sûr apprendre à l’algorithme à quoi ressemble un bagage abandonné, et c’est là que l’IA entre en jeu. Les développeurs ont alimenté le programme avec une énorme banque d’images de sacs isolés dans la rue – une banque qui continue de s’enrichir au fur et à mesure que les images s’accumulent.

Il est important de noter que ce processus « d’apprentissage » ne se produit pas au niveau de l’interface client, mais uniquement dans le « back-office », chez les développeurs. Le commissariat de Massy a acheté un produit autonome qui surveille les caméras, mais qui ne peut pas lui-même acquérir de nouvelles connaissances.

Détecter un bagage sans surveillance est une tâche relativement facile. Repérer une personne à terre dans une foule, voir la bosse dans les vêtements d’une personne qui est une arme cachée ou faire la différence entre le début d’une bagarre et une augmentation temporaire et innocente de la densité de la foule, voilà qui est beaucoup plus difficile.

Une start-up française spécialisée dans les logiciels de vision par ordinateur, le groupe XXII, attend de nouvelles spécifications du gouvernement français avant de peaufiner son offre pour une partie du contrat de vidéosurveillance des Jeux olympiques.

« Nous nous attendons à ce que le gouvernement souhaite que l’IA soit capable de détecter les incendies, les combats, les personnes au sol et les bagages abandonnés », explique François Mattens, de XXII. « Mais il doit se ressaisir.

« En théorie, les nouveaux systèmes sont censés être en place pour la Coupe du monde de rugby [en France] en septembre. Mais il n’en est absolument pas question. Tout cela va prendre beaucoup de temps à mettre en place ».

François Mattens et d’autres développeurs sont conscients de la critique selon laquelle ils permettent des niveaux inacceptables de surveillance par l’État. Mais ils insistent sur les garanties.

« Nous ne fournirons pas – et la loi ne nous le permet pas – de reconnaissance faciale, il s’agit donc d’une opération totalement différente de ce que l’on voit en Chine », explique-t-il.

« Ce qui nous rend attrayants, c’est que nous assurons la sécurité, mais dans le cadre de la loi et de l’éthique.

Mais selon Noémie Levain, militante des droits numériques, il ne s’agit là que d’un « récit » que les développeurs utilisent pour vendre leur produit – sachant pertinemment que le gouvernement favorisera très certainement les entreprises françaises par rapport aux entreprises étrangères lorsqu’il s’agira d’attribuer les contrats pour les Jeux olympiques.

« Ils disent que le fait qu’il n’y ait pas de reconnaissance faciale fait toute la différence. Nous disons que c’est essentiellement la même chose », explique-t-elle.

« La vidéosurveillance par IA est un outil de surveillance qui permet à l’État d’analyser nos corps, nos comportements, et de décider s’ils sont normaux ou suspects. Même sans reconnaissance faciale, elle permet un contrôle de masse.

« Nous considérons que c’est tout aussi effrayant que ce qui se passe en Chine. C’est le même principe de perte du droit à l’anonymat, du droit d’agir comme on le souhaite en public, du droit de ne pas être surveillé ».

Source en anglais : https://www.bbc.com/news/world-europe-66122743